一、AGV多傳感器融合實時避障系統(tǒng)介紹

1.簡介

傳感器融合技術(shù)是機器人實現(xiàn)全覆蓋避障的關(guān)鍵����,其原理仿效人腦綜合處理信息的方式:通過協(xié)調(diào)多種傳感器(如激光雷達����、視覺攝像頭等)進行多層次��、多維度的信息整合�,彌補單一傳感器的局限�,最終構(gòu)建出對環(huán)境的一致性感知。該技術(shù)既能融合多源數(shù)據(jù)的互補優(yōu)勢(如精準(zhǔn)測距與物體識別)���,又能通過智能算法優(yōu)化信息處理流程,使AGV(自動導(dǎo)引車)在復(fù)雜動態(tài)環(huán)境中同步提升避障精度與環(huán)境適應(yīng)力����。

2.提高檢測精度

融合激光雷達(精確測距����,但強光易干擾)�����、視覺(識別物體類型,弱光受限)及超聲波(近距盲區(qū)探測)等多傳感器數(shù)據(jù)����,互補短板���,增強障礙物識別準(zhǔn)確性�����。

3.強化系統(tǒng)可靠性

冗余設(shè)計確保單一傳感器故障時(如激光雷達失效),其他傳感器仍可維持避障;結(jié)合卡爾曼濾波等算法���,濾除噪聲干擾,提升數(shù)據(jù)穩(wěn)定性����。

4.擴展環(huán)境適應(yīng)性

動態(tài)切換優(yōu)勢傳感器應(yīng)對復(fù)雜場景�,如電磁干擾時選用抗擾數(shù)據(jù)����、煙霧環(huán)境中融合超聲波與激光雷達,并針對透明/懸空障礙物啟用紅外等專項傳感器���。

5.優(yōu)化避障決策

通過多傳感器分區(qū)感知(如前方劃設(shè)避障/繞行區(qū)),綜合障礙物距離(激光雷達)���、類型(視覺)及近距信息(超聲波),生成全局環(huán)境模型����,精準(zhǔn)規(guī)劃最優(yōu)路徑�。

二�����、多傳感器融合避障原理

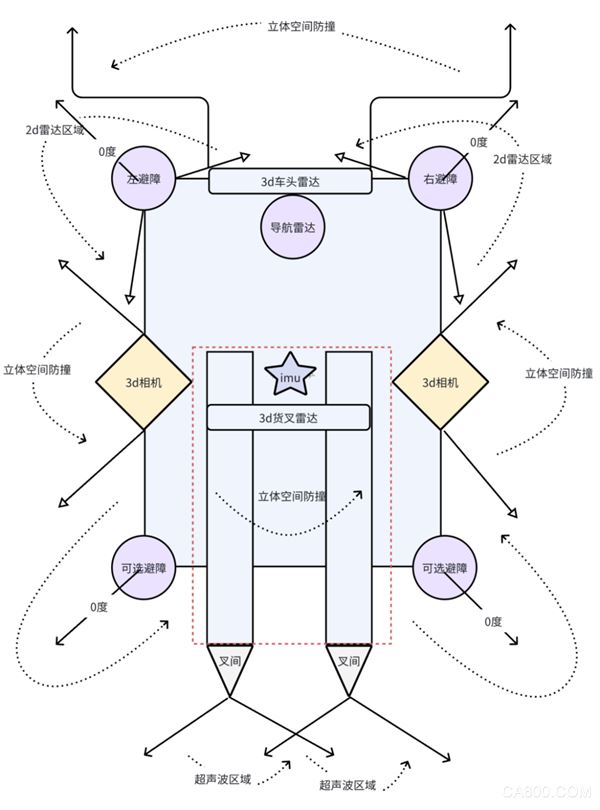

1.典型布局

前方主避障:左右2D激光水平掃描障礙��,底部超聲波補充低矮障礙檢測,前上方斜置3D激光覆蓋立體空間。

側(cè)向防護:兩側(cè)斜裝深度相機,消除AGV橫向盲區(qū)�����。

貨叉防撞:貨叉搭載IMU實時監(jiān)測姿態(tài)���,結(jié)合上下3D激光數(shù)據(jù)���,動態(tài)預(yù)測貨叉運動軌跡并防護周邊區(qū)域����。

叉間防撞:雙超聲波傳感器監(jiān)控車尾兩側(cè)扇形區(qū)域障礙物。

(↑多傳感器融合典型布局圖)

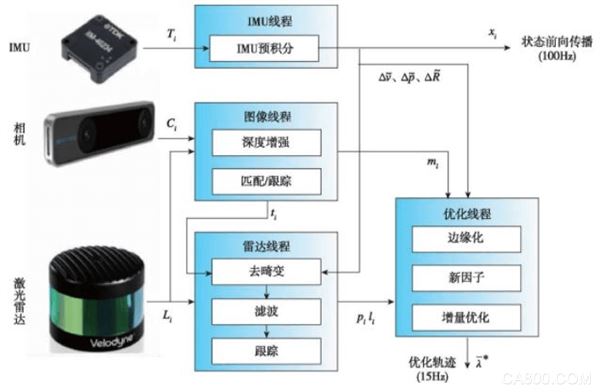

2.融合方法

數(shù)據(jù)級:統(tǒng)一多傳感器時間戳與坐標(biāo)系��,直接合并點云數(shù)據(jù)���。

特征級:融合激光雷達邊緣特征與視覺SIFT特征�,利用PointNet++(點云)和CNN(圖像)進行深度學(xué)習(xí),或通過EKF生成障礙物概率地圖��。

決策級:貝葉斯網(wǎng)絡(luò)動態(tài)加權(quán)各傳感器置信度�����,緊急場景超聲波觸發(fā)急停��,激光雷達規(guī)劃繞行路徑。

(↑多傳感器緊耦合融合經(jīng)典方法)

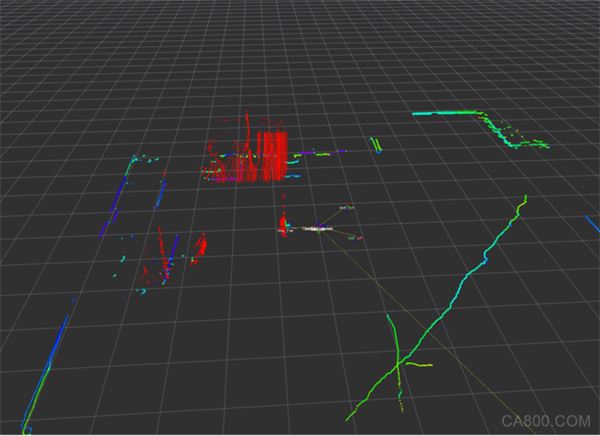

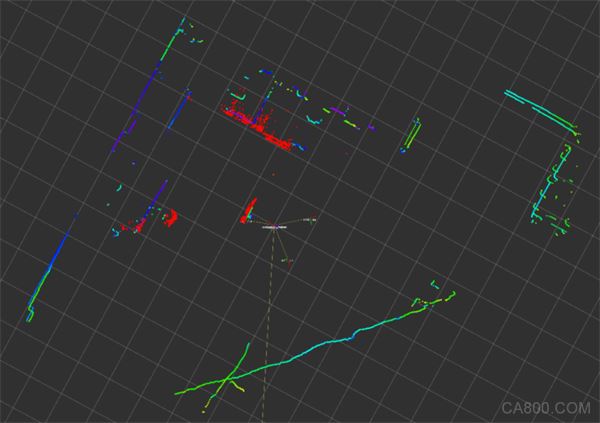

3.環(huán)境感知

遠近分工:3D雷達點云檢測遠端全局障礙,深度相機識別近端局部障礙�。

障礙物定義:包括人員���、貨物、叉車等具有體積的物體�����,核心流程為“檢測→跟蹤→定位”(確認存在→軌跡預(yù)測→距離計算)

語義地圖:通過實例分割標(biāo)注障礙物類別(如貨架�����、電梯)���,提取輪廓映射至地圖����,支撐智能避障決策�����。

(↑2d與3d點云數(shù)據(jù)級融合純點云地圖(三維視角))

(↑2d與3d點云數(shù)據(jù)級融合純點云地圖(俯視視角))

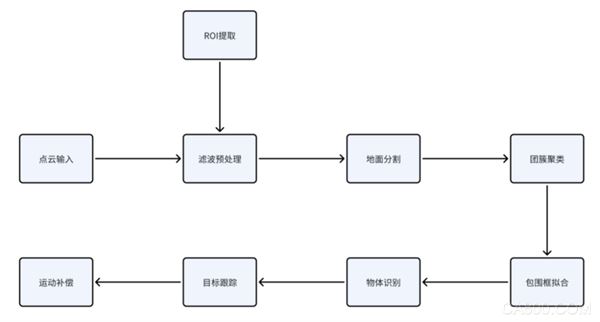

全局避障處理流程:針對點云數(shù)據(jù)量大且含噪聲的問題��,先進行濾波降采樣;分割地面點云后��,通過聚類算法分割地面障礙物團簇�,擬合包圍框標(biāo)注中心/尺寸等屬性;結(jié)合點云目標(biāo)檢測框架(如PointPillar)進行語義標(biāo)注與跟蹤����,并構(gòu)建卡爾曼濾波器平滑軌跡�����,同步優(yōu)化算力保障實時性;存在運動畸變時需補償校正�。

(↑點云避障感知層算法框架)

4.實時避障算法

局部避障:深度相機覆蓋車身近周區(qū)域�����,貨叉IMU實時反饋姿態(tài)角����,底部傳感器監(jiān)測空間障礙。

路徑重規(guī)劃:基于AGV速度(100-200ms周期)���,通過動態(tài)窗口法采樣可行軌跡,預(yù)測動態(tài)障礙運動趨勢���,實時優(yōu)化路徑��。

強化學(xué)習(xí)輔助:結(jié)合DQN、PPO等算法��,在仿真環(huán)境中訓(xùn)練AGV適應(yīng)復(fù)雜動態(tài)場景�,提升自主決策能力。

三�����、多傳感器融合避障挑戰(zhàn)與未來

1.AGV避障應(yīng)用場景

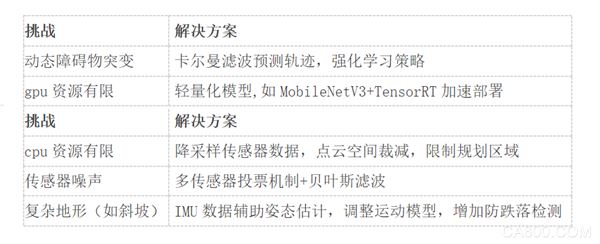

AGV避障實際應(yīng)用場景中����,往往會遇到一些困難,以下列舉一些挑戰(zhàn)和解決方案:

2.未來方向

仿生策略:模仿蟻群/鳥群行為�,預(yù)測動態(tài)障礙物軌跡����。

神經(jīng)融合:端到端模型(如PointNet+++Transformer)直接處理LiDAR與視覺數(shù)據(jù)�。

類腦架構(gòu):脈沖神經(jīng)網(wǎng)絡(luò)(SNN)實現(xiàn)低功耗決策,LSTM+注意力機制預(yù)測長時序障礙物運動�����。

協(xié)同計算:云-邊-端分層處理��,降低車載算力壓力。

仿真遷移:域隨機化增強泛化性,在線自適應(yīng)實時微調(diào)模型(如Meta-RL)��。

群體智能:聯(lián)邦學(xué)習(xí)優(yōu)化多AGV路徑���,博弈論動態(tài)協(xié)調(diào)通行權(quán)��。

目標(biāo):構(gòu)建“感知-決策-控制”全鏈路智能化系統(tǒng)���,通過生物啟發(fā)算法���、跨域協(xié)同(V2X/數(shù)字孿生)及高能效硬件�����,實現(xiàn)復(fù)雜環(huán)境下類人駕駛能力,兼顧安全�����、效率與倫理��。

原文:海豚之星AiTEN機器人公眾號